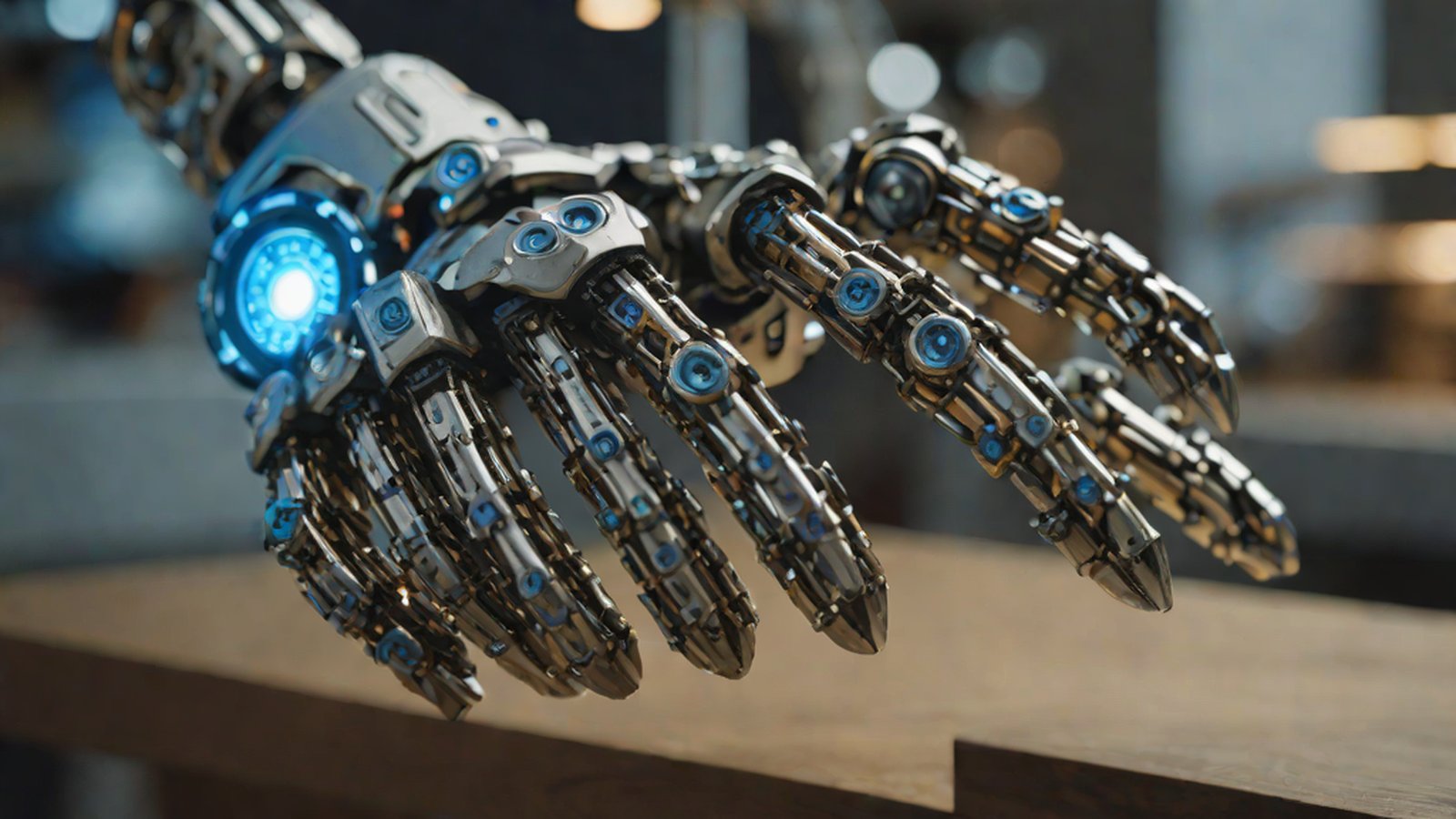

以 Gemini 2.0 為基礎的 Gemini Robotics 是一項創新技術,能讓機器人理解複雜環境、使用工具,並自主判斷後採取行動。

機器人,現在不再只是聽從「指令」,而是開始理解「狀況」

想像一下,客廳中央堆滿了衣服。你對機器人說:「幫我整理一下。」如果是傳統的機器人,只會按照預先設定的程式「拿起衣服放入籃子」來行動。但如果那堆衣服中混入了機器人從未見過的絲綢洋裝或是易碎裝飾品呢?或者突然有一隻貓從衣服堆裡跳出來呢?

Google DeepMind 展現的 Gemini Robotics 正是讓機器人在這種例外狀況下能自主「思考」與「判斷」的技術 Gemini Robotics 將 AI 帶入物理世界。現在,AI 正超越螢幕上的文字與圖像,直接走進我們生活的現實物理世界(Physical World)。這不僅僅是冰冷的機械手臂在移動,而是具備了像人類一樣察覺狀況並應對的能力。

為什麼這很重要?

到目前為止,大多數機器人都是「反應式系統(Reactive Systems)」。簡單來說,必須輸入成千上萬條類似「看到 A 就做 B」的規則。然而,我們生活的世界極其複雜且變化莫測。客廳地板上一隻襪子的位置每天都不同,物體的形狀也會隨光線角度而改變。人類幾乎不可能為所有這些狀況預先設定規則。

Gemini Robotics 的重要性在於將機器人從單純的機器進化為「通用代理(General-purpose agents,能自主執行多種目標的代理人)」 Gemini Robotics 1.5 將 AI 代理帶入物理世界。這意味著機器人可以自主解決複雜的物理任務,並能靈活適應陌生環境或初次聽到的指示 論文頁面 - Gemini Robotics: 將 AI 帶入物理世界。

Google DeepMind 將此描述為「在物理世界中實現通用人工智慧(AGI,人類水準的智慧)的重要步驟」 Google DeepMind 揭曉 Gemini Robotics 1.5,將 AI 代理帶入物理世界。也就是說,AI 不僅擁有聰明的頭腦,還能完美控制實際行動的「身體」。

輕鬆理解:機器人的「眼睛、嘴巴、雙手」合而為一

要理解 Gemini Robotics,需要了解 VLA 模型這個術語。VLA 是視覺(Vision)、語言(Language)、行動(Action)的首字母縮寫 Gemini Robotics: 將 AI 帶入物理世界 - YouTube。

讓我們用日常生活來比喻。想像你在廚房做菜的情況:

- 視覺 (Vision):即時觀察砧板上的食材切得如何,鍋裡的水是否煮沸溢出。

- 語言 (Language):聽懂旁邊幫忙的家人說「火關小一點」。

- 行動 (Action):根據從眼睛和耳朵獲得的資訊,移動雙手調整瓦斯爐火力並切菜。

以往必須分別製作負責這三種功能的 AI 並將其連接起來。例如負責眼睛的 AI 提供資訊後,負責嘴巴的 AI 進行解讀,再向負責手的 AI 下達指令。但 Gemini Robotics 以 Google 最新的 AI Gemini 2.0 為基礎,在一個巨大的「大腦」中同時處理所有過程 Gemini Robotics: 將 AI 帶入物理世界 - ADS。

因此,機器人具備了能即時回應使用者聲音、根據眼前狀況變化敏捷調整手部動作的「靈巧技能(Dexterous)」 Gemini Robotics: 將 AI 帶入物理世界 - LinkedIn。特別是 Gemini Robotics-ER(具身推理,Embodied Reasoning) 模型,賦予了機器人卓越的空間與時間理解能力 Gemini Robotics: 將 AI 帶入物理世界 - arXiv。機器人不僅僅是看到物體,還能預測未來並行動,例如「如果移開這個杯子,後面的盤子可能會倒下來」。 Google DeepMind 推出兩款基於 Gemini 的模型,將 AI 帶入現實世界。

現狀:「會思考的機器人」的出現與進化

在 2025 年這一年,Google DeepMind 飛躍性地發展了這項技術,不斷突破機器人的極限。

- 2025 年 3 月:基於 Gemini 2.0 的 Gemini Robotics 和 Gemini Robotics-ER 首次向世人公開。機器人與人類自然互動並執行複雜指令的模樣令全世界震驚 Gemini Robotics 將 AI 帶入物理世界。

- 2025 年 6 月:推出了機器人無需網路連接即可在現場直接判斷並行動的「裝置端(On-Device)」模型 Google 推出可在機器人本地運行的全新 Gemini 模型。這使得機器人即使在安全至上的工廠或網路訊號無法到達的荒野環境中,也能自主生存並完成任務。

- 2025 年 9 月:公開了更強大的 1.5 版本 Google DeepMind 揭曉其首款「思考型」機器人 AI。特別是 Gemini Robotics-ER 1.5 具備了字面意義上的「思考(Thinking)」能力,收到複雜指示後會自主制定策略。如果遇到未知的資訊,還會直接調用 Google 搜尋等外部工具來尋找答案 Google DeepMind 揭曉其首款「思考型」機器人 AI。

比喻來說,如果以前的機器人只是勉強完成交辦事項的「新手實習生」,那麼現在已經脫胎換骨成為能自主搜尋未知事物並解決問題的「資深專家」 Gemini Robotics 將 AI 帶入物理世界 - Digital India。

未來會如何發展?

目前 Gemini Robotics-ER 1.5 已透過 Google AI Studio 提供給開發者,而 Gemini Robotics 1.5 則以部分合作夥伴為中心先行導入,正在實際產業現場進行測試 Google DeepMind 揭曉 Gemini Robotics 1.5,將 AI 代理帶入物理世界。

這意味著在我們身邊看到更聰明、更有能力的機器人的日子已指日可待。原本只在工廠搬運固定物品的機器人,現在將成為幫忙做家事、管理複雜製程生產線、以及在危險災難現場自主判斷拯救生命的夥伴。曾經是數位世界天才的 AI,現在獲得了強健的身體,正大步向我們走來。機器人超越「工具」成為我們「夥伴」的未來,你準備好了嗎?

AI 的視角

MindTickleBytes 的 AI 記者視角: AI 不僅在西洋棋中獲勝、繪製精美圖畫,現在更準備好拿起掃帚打掃房間或修理複雜機器。Gemini Robotics 將成為開啟 AI 不再停留在抽象「數據」領域,而是延伸到實際物理「行動」的真正代理時代的鑰匙。最令人振奮的是,機器人不再僅僅將人類語言理解為文本,而是開始掌握其中蘊含的意圖與物理語境。

參考資料

- Gemini Robotics 1.5 將 AI 代理帶入物理世界

- Gemini Robotics: 將 AI 帶入物理世界 (arXiv:2503.20020)

- Gemini Robotics: 將 AI 帶入物理世界 - YouTube

- Google 新聞 - Google DeepMind 推出 Gemini Robotics - 概覽

- 論文頁面 - Gemini Robotics: 將 AI 帶入物理世界

- Gemini Robotics: 將 AI 帶入物理世界 - LinkedIn

-

[Gemini Robotics 將 AI 帶入物理世界… TechNews](https://news-tech.io/ko/news/gemini-robotics-brings-ai-into-the-physical-world) - Gemini Robotics 將 AI 帶入物理世界 - Digital India

- Google DeepMind, 基於 Gemini 的 VLA(Vision-Language-Action) 模型…

- Gemini Robotics 將 AI 帶入物理世界 - Google DeepMind 部落格

- Google DeepMind 揭曉 Gemini Robotics 1.5,將 AI 代理帶入物理世界

- Gemini Robotics: 將 AI 帶入物理世界 - ADS

- Google DeepMind 推出兩款基於 Gemini 的模型,將 AI 帶入現實世界

- Google 推出可在機器人本地運行的全新 Gemini 模型

- Google DeepMind 揭曉其首款「思考型」機器人 AI

- Gemini 1.0

- Gemini 1.5 Pro

- Gemini 2.0

- Gemini Robotics-ER

- Gemini Robotics On-Device

- Gemini Robotics 1.5

- 連接圖書館資料庫

- 調用 Google 搜尋等工具

- 詢問人類