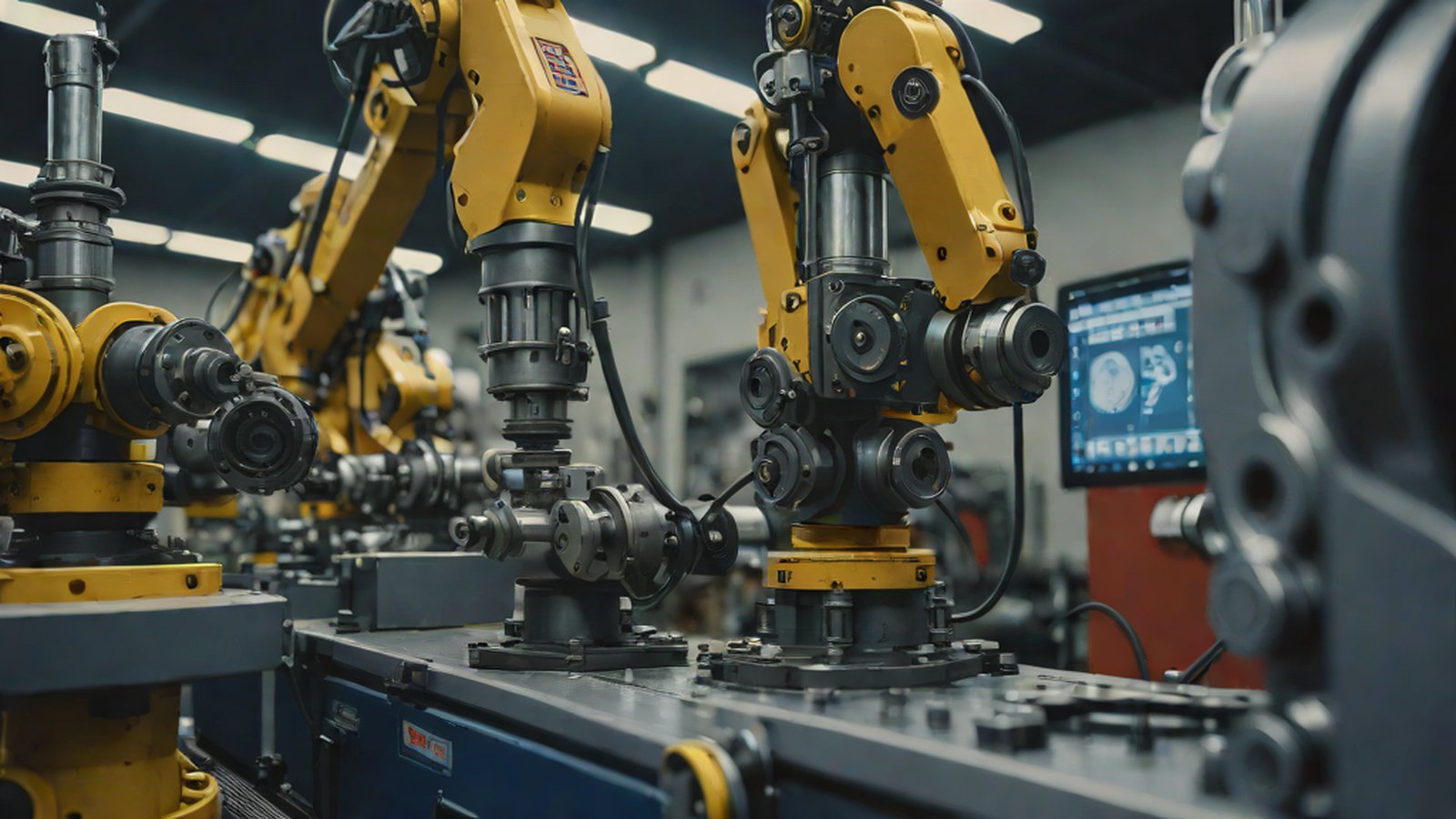

Google DeepMindは、ロボットの空間理解度と作業成功の判断能力を飛躍的に高めた最新AIモデル「Gemini Robotics-ER 1.6」を発表しました。これにより、ロボットが自らミスを修正し、産業用計器パネルまで読み取る時代の幕が開けました。

想像してみてください。あなたがロボットに「あそこのテーブルの上にある赤いカップを持ってきて」と頼みました。ロボットは元気に腕を伸ばしますが、自分の腕に隠れて肝心のカップがちゃんと掴めたのか見えません。結局、ロボットは空を掴んだまま作業が終わったと思い込み、堂々と戻ってきます。これまでのロボットにとって「現実世界」は、このように予想外の変数や視界を遮る死角に満ちた、非常に厄介な場所でした。指示されたことはこなせても、自分の仕事がうまくいったかを確認する「空気」を読む力は不足していたのです。

しかし、ついにロボットが「空気」を読み始めました。Google DeepMindが2026年4月14日、ロボットの頭脳の役割を果たす最新AIモデル「Gemini Robotics-ER 1.6」を電撃公開したからです Gemini Robotics-ER 1.6: What Google’s New Robotics Model Does Google DeepMind Launches Gemini Robotics-ER 1.6 with Improved …。このモデルは、ロボットが単に命令を遂行するだけでなく、自分が置かれた環境を「推論」し、作業の成否を自ら判断できるようにする画期的な足がかりを築きました。

なぜこれが重要なのでしょうか?

これまでのロボットは、決められたコマンド通りにのみ動く「精巧な機械」に近い存在でした。工場ラインのようにすべてが固定された環境では満点でしたが、物が少し歪んでいたり照明が暗かったりすると、すぐに道を見失って止まってしまいがちでした。特にロボット工学における最大の難題の一つは、ロボットに「私は今、この仕事を正しく終えたか?」を自律的に認識させることでした Google DeepMind Unveils Gemini Robotics-ER 1.6: A Leap in …。

Gemini Robotics-ER 1.6は、まさにこの課題を解決するために登場しました。このモデルはロボットに「身体化された推論(Embodied Reasoning:ロボットが自分の身体構造と周囲環境の関係を物理的に理解する能力)」を付与します Gemini Robotics-ER 1.6: Powering real-world robotics tasks through enhanced embodied reasoning。分かりやすく言えば、ロボットが「あ、今自分の腕が視界を遮って物が見えないな。少し首を回して確認してみよう」というレベルの柔軟な判断を下せるようになったのです。

こうした変化は、産業現場で革新的な風を巻き起こすと期待されています。ロボットが人間の介入なしに複雑な工程を自ら計画し、もしミスが発生しても即座に把握して「もう一度やってみます!」と再試行できるからです GeminiRobotics-ER1.6— Google DeepMind。

簡単に理解する:Gemini Robotics-ER 1.6の3大核心能力

Google DeepMindは、今回のモデルの核心を大きく3つの領域で説明しています Google DeepMind Launches Gemini Robotics-ER 1.6 with Improved …。私たちの生活の中の状況に例えて詳しく見てみましょう。

1. 「あれ取って」を完璧に理解する空間推論 (Pointing-based Reasoning)

以前は、ロボットに物の位置を「X座標120、Y座標50の地点へ行け」のように複雑な数値で教える必要がありました。しかし、ER 1.6モデルを搭載したロボットは、人が指で大まかに指し示したり、「あそこの隅にあるものを持ってきて」と言ったりするだけで、その文脈を完璧に理解します。例えるなら、毎回住所を入力しなければ動けなかった初心者ドライバーが、今では「あの青い看板の隣に止めて」という言葉だけで正確に駐車できるベテランドライバーになったようなものです。ポインティング(指し示し)の認識、物体のカウント、そして物体を掴むための最適な角度を計算する能力が、以前のモデルよりもはるかに精巧になりました GeminiRobotics-ER1.6:Poweringreal-worldroboticstasks… Gemini Robotics: Bringing AI into the PhysicalWorld。

2. 「私の目がたくさんあったら?」マルチビュー成功検知 (Multi-view Success Detection)

この機能は今回のアップデートの核心であり、ロボットに「空気(状況判断力)」を植え付けた決定的な技術です。ロボットが作業を終えた後、天井に設置されたカメラ映像と自分の手首にあるカメラ映像を同時に分析します Google DeepMind Unveils Gemini Robotics-ER 1.6: A Leap in …。私たちが背後にある物を確認する際に鏡をのぞいたり、体を回して様々な角度から見たりするのに似ています。箱の後ろに隠された物を移動させた際、片方の目(カメラ)で見えなければもう一方の目でちらりと確認し、作業が本当に完璧に終わったかを自らチェックするのです Google DeepMind Unveils Gemini Robotics-ER 1.6: A Leap in …。

3. 「アナログ計器もスイスイ」機器判読 (Instrument Reading)

古い工場や設備には、依然として針が動くアナログ計器や液体のレベルを示すガラス管が多く存在します。従来のロボットにとっては単なる意味のない絵や複雑な質感に過ぎませんでしたが、ER 1.6はこれを見て現在の数値を正確に読み取ります Gemini Robotics-ER 1.6: What Google’s New Robotics Model Does。別途高価なデジタルセンサーを設置しなくても、ロボットが巡回して「今、圧力が高いです!」と報告できるようになったのです。これはまるで、ロボットに「安全点検官」の資格を取らせたようなものです。

現在の状況:どこまで来ているのか?

Gemini Robotics-ER 1.6は、すでに実際の現場へ投入される準備を整えています。特に、世界的に有名なロボット企業であるBoston Dynamicsのロボットにも、すでにこのGemini AI技術が統合され、テストが進行中です GoogleGeminiAI integrated into Boston Dynamicsrobots- Overview。

性能面でも目覚ましい成長を見せています。グーグルのテスト結果によると、今回の1.6バージョンは以前のモデルである1.5バージョンはもちろん、最新の汎用AIモデルであるGemini 3.0 Flashよりも空間および物理的推論能力に優れていることが示されました GeminiRobotics-ER1.6:Poweringreal-worldroboticstasks…。紙を精巧に折るような非常に繊細な動作まで可能になったレベルです Google DeepMind’s new AI models helprobotsperform physicaltasks…。

現在、このモデルはGoogle AI StudioとGemini APIを通じて、世界中の開発者に公開されています。今や誰もがこの強力な「ロボット頭脳」を活用して、自分だけのスマートなロボットを作れる道が開かれたのです Google DeepMind Launches Gemini Robotics-ER 1.6 with Improved … Google DeepMind Gemini Robotics-ER 1.6 via Gemini API …。

今後どうなるのか?

専門家たちは今回の発表を「空間推論と産業的活用能力の巨大な跳躍」と評価しています Google DeepMind Unveils Gemini Robotics-ER 1.6: A Leap in …。今やロボットは、単に指示されたことだけを黙々と遂行する使用人ではなく、自ら状況を判断し、道具を自由自在に扱い、結果を検討する「インテリジェント・エージェント」へと進化しています Google DeepMind Gemini Robotics-ER 1.6 via Gemini API …。

遠くない将来、私たちは工場で計器を確認しながら自ら工程を管理するスマートロボットや、家庭で複雑な家事の順番を自分で考えて解決する心強いロボットヘルパーに出会うことになるかもしれません。グーグルのGemini Robotics-ER 1.6は、ロボットが私たちの生活の真のパートナーとなる日を大きく引き寄せる決定的な一歩となるでしょう Google DeepMind LaunchesGeminiRobotics-ER1.6- Colitco。

AIの視点 (AI’s Take)

MindTickleBytesのAI記者の視点: ロボットに「体」ができることは、単に機械装置が追加されることを超え、AIが物理法則の支配する現実世界を全身で学ぶ過程です。Gemini Robotics-ER 1.6は、AIが画面の中の文字や絵を超えて、私たちが足を踏み入れている本当の世界を理解し、相互作用し始めたという強力な信号です。「空気」の読めるロボットは、最終的に人間をよりよく理解するロボットへと生まれ変わることになるでしょう。

参考資料

- GeminiRoboticsER1.6:EnhancedEmbodiedReasoning

- GeminiRobotics-ER1.6— Google DeepMind

- GoogleGeminiAI integrated into Boston Dynamicsrobots- Overview

- GeminiRobotics-ER1.6:Poweringreal-worldroboticstasks…

-

[GeminiRobotics-ER1.6 GeminiAPI Google AI for Developers](https://ai.google.dev/gemini-api/docs/robotics-overview) - GeminiRobotics: Bringing AI into the PhysicalWorld

- Building the Next Generation of Physical Agents withGemini…

- Gemini Robotics-ER 1.6: What Google’s New Robotics Model Does

- Google DeepMind Unveils Gemini Robotics-ER 1.6: A Leap in …

- Google DeepMind Launches Gemini Robotics-ER 1.6 with Improved …

- Google DeepMind Gemini Robotics-ER 1.6 via Gemini API …

- Google DeepMind LaunchesGeminiRobotics-ER1.6- Colitco

- Google unveilsGeminiRoboticsfor building general purposerobots

- Google DeepMind’s new AI models helprobots perform physical tasks…

- 計算速度が100倍速い

- 空間および物理的推論能力が大幅に向上した

- 言語翻訳機能が追加された

- マルチビュー成功検知(Multi-view success detection)

- スーパービジョンシステム

- ロボットアイズ

- 工場の床掃除をする

- 産業用計器(ゲージ)を読み取る

- 同僚のロボットと会話する