Google DeepMind 發佈了大幅提升機器人空間理解與任務成功判斷能力的最新 AI 模型「Gemini Robotics-ER 1.6」,開啟了機器人能自主修正錯誤,甚至讀取工業儀表板的新時代。

想像一下,你對機器人說:「幫我拿那邊桌子上的紅色杯子。」機器人雖然勇敢地伸出手臂,但因為手臂擋住了視線,根本看不清楚杯子是否真的抓穩了。結果,機器人抓了一把空氣後,卻以為任務已經完成,大搖大擺地回來了。對過去的機器人來說,「現實世界」就是這樣一個充滿不可預測變數和視線死角的棘手場所。雖然很會做事,但卻缺乏確認自己是否做得好的「眼色」。

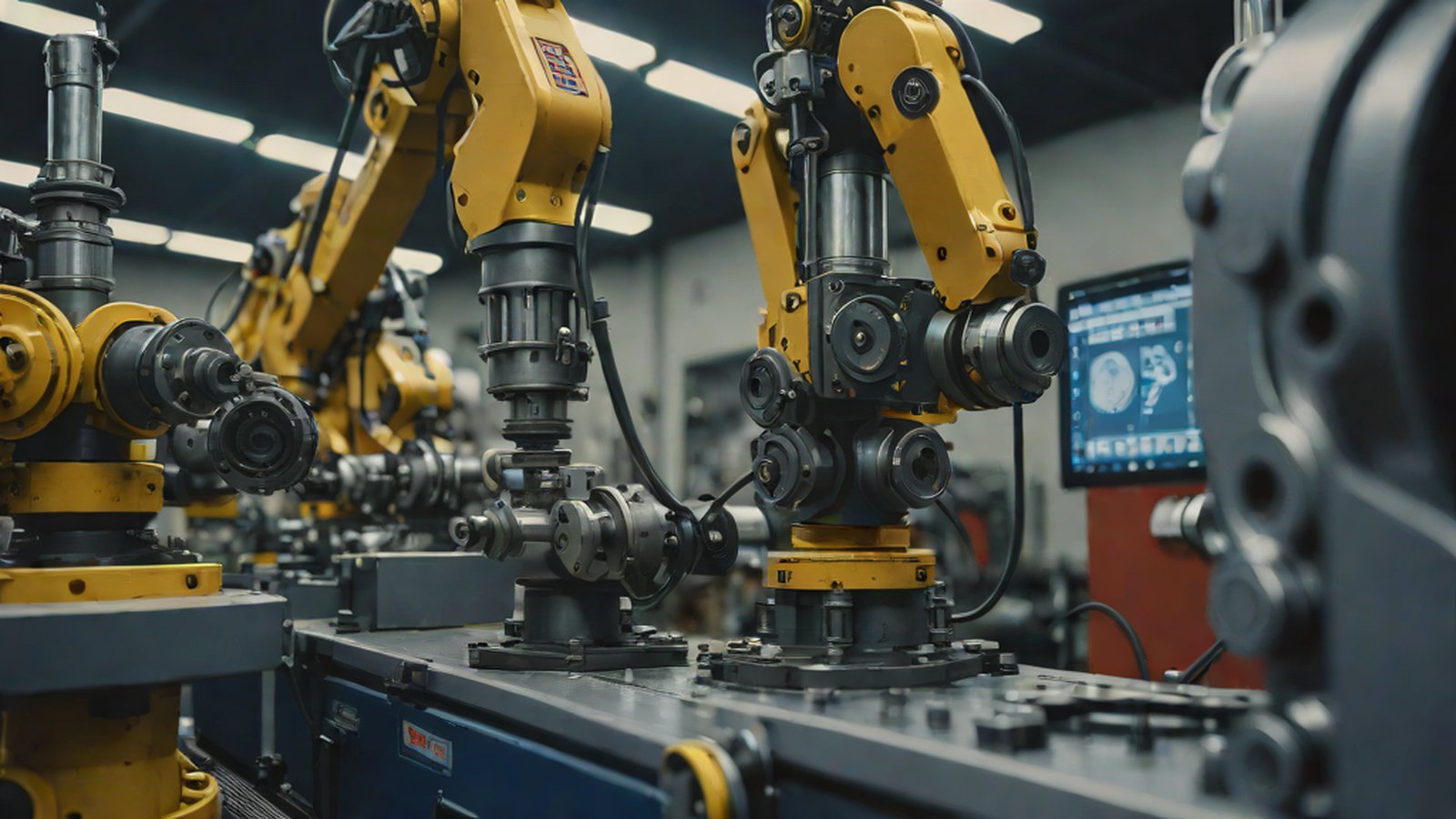

不過現在,機器人終於開始會「看眼色」了。因為 Google DeepMind 於 2026 年 4 月 14 日,正式公開了擔任機器人大腦角色的最新 AI 模型 「Gemini Robotics-ER 1.6」 Gemini Robotics-ER 1.6: What Google’s New Robotics Model Does Google DeepMind Launches Gemini Robotics-ER 1.6 with Improved …。這個模型為機器人奠定了重要的里程碑,讓它們不僅能執行命令,還能對所處環境進行「推理」,並自主判斷任務是否成功。

為什麼這很重要?

到目前為止,機器人更接近於僅依據既定指令動作的「精密機器」。在工廠生產線這種所有東西都固定的環境中,它們表現近乎完美;但只要物品稍微歪了一點或燈光變暗,它們很快就會迷失方向而停止運作。特別是機器人工程界最大的難題之一,就是如何讓機器人自我感知:「我現在真的把這件事做好了嗎?」 Google DeepMind Unveils Gemini Robotics-ER 1.6: A Leap in …

Gemini Robotics-ER 1.6 就是為了縮短這個差距而誕生。它賦予了機器人 「體現推理(Embodied Reasoning,機器人物理性理解自身身體結構與周遭環境關係的能力)」 Gemini Robotics-ER 1.6: Powering real-world robotics tasks through enhanced embodied reasoning。簡單來說,機器人現在能做出這種程度的靈活判斷:「啊,現在手臂擋住了視線看不見東西,我應該稍微轉一下頭確認一下。」

這種變化預計將在工業現場掀起創新浪潮。因為機器人即使沒有人類的逐一介入,也能自主規劃複雜流程,萬一發生錯誤,也能立即察覺並說出「我再試一次!」來重新嘗試 GeminiRobotics-ER1.6— Google DeepMind。

輕鬆理解:Gemini Robotics-ER 1.6 的三大核心能力

Google DeepMind 將這次模型的核心歸納為三大領域 Google DeepMind Launches Gemini Robotics-ER 1.6 with Improved …。讓我們用生活中的情境來更詳細地了解:

1. 聽懂「幫我拿那個」的空間推理 (Pointing-based Reasoning)

以前必須用複雜的數字告訴機器人位置,例如「前往 X 座標 120, Y 座標 50 的地點」。但搭載 ER 1.6 模型的機器人,即使人類只是用手指大概指一下,或說聲「把那個角落的東西拿過來」,它也能精確理解語境。打個比方,就像一個每次都要靠精確地址才能找路的新手駕駛,現在進化成了只要聽一聲「停在那邊藍色招牌旁邊」就能精準停車的老司機。在辨識指向、物體計數以及計算抓取物體的最佳角度方面,它比前代模型精細許多 GeminiRobotics-ER1.6:Poweringreal-worldroboticstasks… Gemini Robotics: Bringing AI into the PhysicalWorld。

2. 「如果我有好幾隻眼睛?」多視角成功偵測 (Multi-view Success Detection)

這項功能是這次更新的核心,也是賦予機器人「看眼色」的關鍵技術。機器人完成工作後,會同時分析安裝在天花板的攝影機影像和自己手腕上的攝影機影像 Google DeepMind Unveils Gemini Robotics-ER 1.6: A Leap in …。這就像我們確認背後的東西時會照鏡子或轉身從多個角度觀察一樣。當移動被箱子遮擋的物品時,如果一隻眼睛(攝影機)看不見,就會用另一隻眼睛撇一眼,自主檢查任務是否真的完美完成了 Google DeepMind Unveils Gemini Robotics-ER 1.6: A Leap in …。

3. 「模擬儀表板也難不倒」儀器讀取 (Instrument Reading)

老舊的工廠或設施中,仍然有許多指針在動的模擬儀表或顯示液位高度的玻璃管。對傳統機器人來說,那只是無意義的圖案或複雜的紋理,但 ER 1.6 卻能精確讀取當前數值 Gemini Robotics-ER 1.6: What Google’s New Robotics Model Does。這意味著即使不安裝昂貴的數位感應器,機器人也能巡視並報告:「現在壓力太高了!」這簡直就像讓機器人考取了「安全檢查員」執照一樣。

目前狀況:發展到哪裡了?

Gemini Robotics-ER 1.6 已經準備好投入實際現場。特別是全球知名的機器人公司 波士頓動力 (Boston Dynamics) 的機器人們,也已經整合了這項 Gemini AI 技術並正在進行測試 GoogleGeminiAI integrated into Boston Dynamicsrobots- Overview。

在效能方面也展現了亮眼的成長。根據 Google 的測試結果,這次的 1.6 版本在空間與物理推理能力上,不僅優於之前的 1.5 版本,甚至超越了最新的通用 AI 模型 Gemini 3.0 Flash GeminiRobotics-ER1.6:Poweringreal-worldroboticstasks…。目前已經進步到可以完成像精確折紙這樣極其細膩的動作 Google DeepMind’s new AI models helprobotsperform physicaltasks…。

目前該模型已透過 Google AI Studio 和 Gemini API 向全球開發者開放。這意味著任何人現在都能利用這個強大的「機器人大腦」來打造屬於自己的智慧型機器人 Google DeepMind Launches Gemini Robotics-ER 1.6 with Improved … Google DeepMind Gemini Robotics-ER 1.6 via Gemini API …。

未來會如何發展?

專家們評價這次發佈是 「空間推理與工業應用能力的巨大飛躍」 Google DeepMind Unveils Gemini Robotics-ER 1.6: A Leap in …。現在機器人不再只是默默執行指令的僕人,而是進化成能自主判斷狀況、自如運用工具並檢查結果的「智慧型代理人(Intelligent Agent)」 Google DeepMind Gemini Robotics-ER 1.6 via Gemini API …。

在不久的將來,我們可能會在工廠見到能自行確認儀表並管理流程的智慧型機器人,或者在家庭中遇見能自主規劃家事順序並解決問題的可靠機器人助手。Google 的 Gemini Robotics-ER 1.6 將成為讓機器人成為我們生活中真正夥伴的關鍵一步 Google DeepMind LaunchesGeminiRobotics-ER1.6- Colitco。

AI 的視角 (AI’s Take)

MindTickleBytes AI 記者的視角: 賦予機器人「身體」不僅僅是增加機械裝置,更是 AI 全身投入學習由物理定律支配的現實世界的過程。Gemini Robotics-ER 1.6 是一個強大的信號,表明 AI 已經超越了螢幕上的文字和圖案,開始理解並與我們腳下的真實世界互動。具備「眼色」的機器人最終將進化成更能理解人類的機器人。

參考資料

- GeminiRoboticsER1.6:EnhancedEmbodiedReasoning

- GeminiRobotics-ER1.6— Google DeepMind

- GoogleGeminiAI integrated into Boston Dynamicsrobots- Overview

- GeminiRobotics-ER1.6:Poweringreal-worldroboticstasks…

-

[GeminiRobotics-ER1.6 GeminiAPI Google AI for Developers](https://ai.google.dev/gemini-api/docs/robotics-overview) - GeminiRobotics: Bringing AI into the PhysicalWorld

- Building the Next Generation of Physical Agents withGemini…

- Gemini Robotics-ER 1.6: What Google’s New Robotics Model Does

- Google DeepMind Unveils Gemini Robotics-ER 1.6: A Leap in …

- Google DeepMind Launches Gemini Robotics-ER 1.6 with Improved …

- Google DeepMind Gemini Robotics-ER 1.6 via Gemini API …

- Google DeepMind LaunchesGeminiRobotics-ER1.6- Colitco

- Google unveilsGeminiRoboticsfor building general purposerobots

- Google DeepMind’s new AI models helprobots perform physical tasks…

- 計算速度快 100 倍

- 空間及物理推理能力大幅提升

- 增加了語言翻譯功能

- 多視角成功偵測 (Multi-view success detection)

- 超級視覺系統

- 機器人之眼

- 清理工廠地板

- 讀取工業儀表板 (指針式錶頭)

- 與機器人同事聊天