구글 딥마인드가 로봇의 공간 이해도와 작업 성공 판단 능력을 비약적으로 높인 최신 AI 모델 'Gemini Robotics-ER 1.6'을 발표하며, 로봇이 스스로 실수를 바로잡고 산업용 계기판까지 읽는 시대를 열었습니다.

상상해보세요. 여러분이 로봇에게 “저기 탁자 위에 있는 빨간 컵 좀 가져다줘”라고 시켰습니다. 로봇은 씩씩하게 팔을 뻗지만, 자신의 팔에 가려 정작 컵이 제대로 잡혔는지 보이지 않습니다. 결국 로봇은 허공을 움켜쥔 채 작업을 끝냈다고 생각하고 당당하게 돌아옵니다. 그동안의 로봇들에게 ‘현실 세계’는 이처럼 예상치 못한 변수와 시야를 가리는 사각지대로 가득한 까다로운 장소였습니다. 시키는 일은 곧잘 해도, 정작 자기가 그 일을 잘했는지 확인하는 ‘눈치’는 부족했던 것이죠.

하지만 이제 로봇이 드디어 눈치를 챙기기 시작했습니다. 구글 딥마인드(Google DeepMind)가 2026년 4월 14일, 로봇의 두뇌 역할을 하는 최신 AI 모델인 ‘Gemini Robotics-ER 1.6’을 전격 공개했기 때문입니다 Gemini Robotics-ER 1.6: What Google’s New Robotics Model Does Google DeepMind Launches Gemini Robotics-ER 1.6 with Improved …. 이 모델은 로봇이 단순히 명령을 수행하는 것을 넘어, 자신이 처한 환경을 ‘추론’하고 작업의 성공 여부를 스스로 판단할 수 있게 해주는 획기적인 발판을 마련했습니다.

이게 왜 중요한가요?

지금까지의 로봇은 정해진 명령어대로만 움직이는 ‘정교한 기계’에 가까웠습니다. 공장 라인처럼 모든 것이 고정된 환경에서는 백점 만점이었지만, 물건이 조금만 비뚤어져 있거나 조명이 어두우면 금세 길을 잃고 멈춰버리곤 했죠. 특히 로봇 공학계의 가장 큰 숙제 중 하나는 로봇이 “내가 지금 이 일을 제대로 끝냈나?”를 스스로 인지하게 만드는 것이었습니다 Google DeepMind Unveils Gemini Robotics-ER 1.6: A Leap in ….

Gemini Robotics-ER 1.6은 바로 이 숙제를 해결하기 위해 등장했습니다. 이 모델은 로봇에게 ‘체화된 추론(Embodied Reasoning, 로봇이 자신의 신체 구조와 주변 환경의 관계를 물리적으로 이해하는 능력)’을 부여합니다 Gemini Robotics-ER 1.6: Powering real-world robotics tasks through enhanced embodied reasoning. 쉽게 말해서, 로봇이 “아, 지금 내 팔이 시야를 가려서 물건이 안 보이네? 고개를 살짝 돌려서 확인해봐야겠군”이라는 수준의 유연한 판단을 내릴 수 있게 된 것입니다.

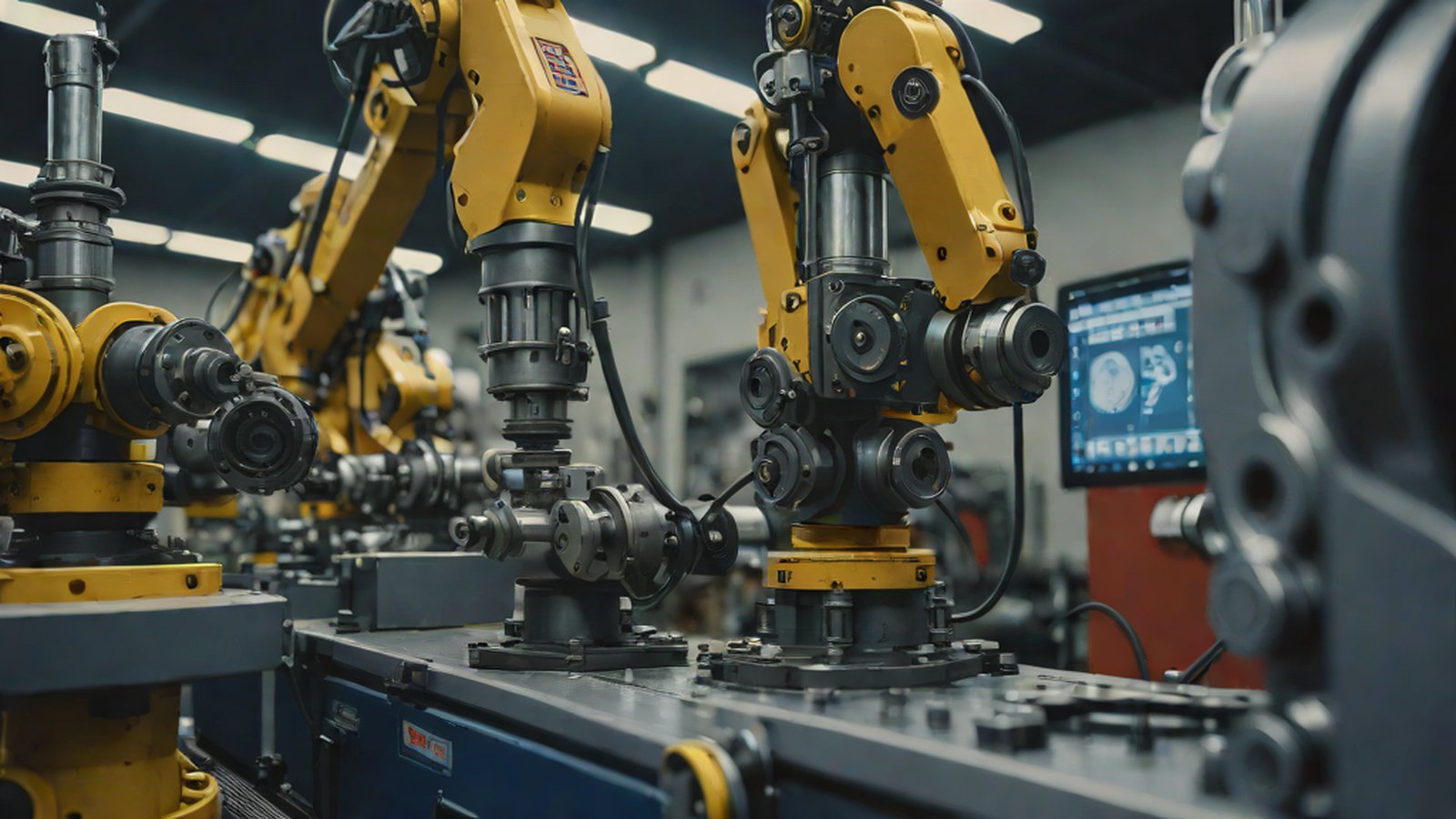

이러한 변화는 산업 현장에서 혁신적인 바람을 일으킬 전망입니다. 로봇이 사람의 일일이 개입하지 않아도 복잡한 공정을 스스로 계획하고, 만약 실수가 발생하더라도 즉시 파악해 “다시 해볼게요!”라며 재시도할 수 있기 때문입니다 GeminiRobotics-ER1.6— Google DeepMind.

쉽게 이해하기: Gemini Robotics-ER 1.6의 3대 핵심 능력

구글 딥마인드는 이번 모델의 핵심을 크게 세 가지 영역으로 설명합니다 Google DeepMind Launches Gemini Robotics-ER 1.6 with Improved …. 우리 생활 속 상황에 비유해 더 자세히 알아볼까요?

1. “저거 집어줘”를 찰떡같이 알아듣는 공간 추론 (Pointing-based Reasoning)

예전에는 로봇에게 물건의 위치를 “X좌표 120, Y좌표 50 지점으로 가라”처럼 복잡한 숫자로 알려줘야 했습니다. 하지만 ER 1.6 모델을 탑재한 로봇은 사람이 손가락으로 대충 가리키거나 “저기 구석에 있는 거 가져와”라고 말해도 그 맥락을 찰떡같이 이해합니다. 비유하자면, 매번 주소를 찍어줘야 움직이던 초보 운전자가 이제는 “저기 파란 간판 옆에 세워줘”라는 말만 듣고도 정확히 주차하는 베테랑 운전자가 된 셈입니다. 포인팅(가리키기) 인식, 물체 개수 세기, 그리고 물체를 잡는 최적의 각도를 계산하는 능력이 이전 모델들보다 훨씬 정교해졌습니다 GeminiRobotics-ER1.6:Poweringreal-worldroboticstasks… Gemini Robotics: Bringing AI into the PhysicalWorld.

2. “내 눈이 여러 개라면?” 멀티 뷰 성공 감지 (Multi-view Success Detection)

이 기능은 이번 업데이트의 핵심이자 로봇에게 ‘눈치’를 심어준 결정적 기술입니다. 로봇이 작업을 마친 후, 천장에 달린 카메라 영상과 자신의 손목에 달린 카메라 영상을 동시에 분석합니다 Google DeepMind Unveils Gemini Robotics-ER 1.6: A Leap in …. 우리가 등 뒤에 있는 물건을 확인할 때 거울을 비춰보거나 몸을 돌려 여러 각도에서 보는 것과 비슷합니다. 상자 뒤에 숨겨진 물건을 옮겼을 때, 한쪽 눈(카메라)에 안 보이면 다른 쪽 눈으로 슬쩍 확인하여 작업이 정말로 완벽하게 끝났는지 스스로 체크하는 것이죠 Google DeepMind Unveils Gemini Robotics-ER 1.6: A Leap in ….

3. “아날로그 계기판도 척척” 기기 판독 (Instrument Reading)

오래된 공장이나 설비에는 여전히 바늘이 움직이는 아날로그 계기판이나 액체 수위를 보여주는 유리관이 많습니다. 기존 로봇들에게는 그저 의미 없는 그림이나 복잡한 질감에 불과했지만, ER 1.6은 이를 보고 현재 수치를 정확히 읽어냅니다 Gemini Robotics-ER 1.6: What Google’s New Robotics Model Does. 별도의 비싼 디지털 센서를 설치하지 않아도 로봇이 돌아다니며 “지금 압력이 너무 높아요!”라고 보고할 수 있게 된 것이죠. 이는 마치 로봇에게 ‘안전 점검관’ 자격증을 따게 해준 것과 같습니다.

현재 상황: 어디까지 왔나?

Gemini Robotics-ER 1.6은 이미 실제 현장에 투입될 준비를 마쳤습니다. 특히 전 세계적으로 유명한 로봇 기업 보스턴 다이내믹스(Boston Dynamics)의 로봇들에도 이미 이 제미나이 AI 기술이 통합되어 테스트가 진행 중입니다 GoogleGeminiAI integrated into Boston Dynamicsrobots- Overview.

성능 면에서도 눈부신 성장을 보여주었습니다. 구글의 테스트 결과에 따르면, 이번 1.6 버전은 이전 모델인 1.5 버전은 물론, 최신 범용 AI 모델인 Gemini 3.0 Flash보다도 공간 및 물리적 추론 능력이 뛰어난 것으로 나타났습니다 GeminiRobotics-ER1.6:Poweringreal-worldroboticstasks…. 종이를 정교하게 접는 것과 같은 아주 섬세한 동작까지도 가능해진 수준입니다 Google DeepMind’s new AI models helprobotsperform physicaltasks….

현재 이 모델은 구글 AI 스튜디오(Google AI Studio)와 Gemini API를 통해 전 세계 개발자들에게 공개되어 있습니다. 이제 누구나 이 강력한 ‘로봇 두뇌’를 활용해 자신만의 스마트한 로봇을 만들 수 있는 길이 열린 셈입니다 Google DeepMind Launches Gemini Robotics-ER 1.6 with Improved … Google DeepMind Gemini Robotics-ER 1.6 via Gemini API ….

앞으로 어떻게 될까?

전문가들은 이번 발표를 “공간 추론과 산업적 활용 능력의 거대한 도약”이라고 평가합니다 Google DeepMind Unveils Gemini Robotics-ER 1.6: A Leap in …. 이제 로봇은 단순히 시키는 것만 묵묵히 수행하는 하인이 아니라, 스스로 상황을 판단하고 도구를 자유자재로 다루며 결과를 검토하는 ‘지능형 에이전트’로 진화하고 있습니다 Google DeepMind Gemini Robotics-ER 1.6 via Gemini API ….

머지않은 미래에 우리는 공장에서 계기판을 확인하며 스스로 공정을 관리하는 스마트 로봇, 혹은 가정에서 복잡한 집안일을 스스로 순서를 짜서 해결하는 든든한 로봇 도우미를 만나게 될지도 모릅니다. 구글의 Gemini Robotics-ER 1.6은 로봇이 우리 삶의 진정한 동반자가 되는 그날을 성큼 앞당기는 결정적인 한 걸음이 될 것입니다 Google DeepMind LaunchesGeminiRobotics-ER1.6- Colitco.

AI의 시선 (AI’s Take)

MindTickleBytes의 AI 기자 시선: 로봇에게 ‘몸’이 생기는 것은 단순히 기계 장치가 추가되는 것을 넘어, AI가 물리 법칙이 지배하는 현실 세계를 온몸으로 배우는 과정입니다. Gemini Robotics-ER 1.6은 AI가 화면 속의 글자와 그림을 넘어, 우리가 발을 딛고 사는 진짜 세상을 이해하고 상호작용하기 시작했다는 강력한 신호입니다. ‘눈치’ 있는 로봇은 결국 인간을 더 잘 이해하는 로봇으로 거듭나게 될 것입니다.

참고자료

- GeminiRoboticsER1.6:EnhancedEmbodiedReasoning

- GeminiRobotics-ER1.6— Google DeepMind

- GoogleGeminiAI integrated into Boston Dynamicsrobots- Overview

- GeminiRobotics-ER1.6:Poweringreal-worldroboticstasks…

-

[GeminiRobotics-ER1.6 GeminiAPI Google AI for Developers](https://ai.google.dev/gemini-api/docs/robotics-overview) - GeminiRobotics: Bringing AI into the PhysicalWorld

- Building the Next Generation of Physical Agents withGemini…

- Gemini Robotics-ER 1.6: What Google’s New Robotics Model Does

- Google DeepMind Unveils Gemini Robotics-ER 1.6: A Leap in …

- Google DeepMind Launches Gemini Robotics-ER 1.6 with Improved …

- Google DeepMind Gemini Robotics-ER 1.6 via Gemini API …

- Google DeepMind LaunchesGeminiRobotics-ER1.6- Colitco

- Google unveilsGeminiRoboticsfor building general purposerobots

- Google DeepMind’s new AI models helprobots perform physical tasks…

- 계산 속도가 100배 빠르다

- 공간 및 물리적 추론 능력이 크게 향상되었다

- 언어 번역 기능이 추가되었다

- 멀티 뷰 성공 감지(Multi-view success detection)

- 슈퍼 비전 시스템

- 로봇 아이즈

- 공장 바닥 청소하기

- 산업용 계기판(게이지) 읽기

- 동료 로봇과 대화하기